Tôi đã hack ChatGPT và AI của Google – và chỉ mất có 20 phútThomas Germain

21 tháng 2 2026, 13:07 +07

BBC

Serenity Strull/ Madeleine Jett

Ngày càng nhiều người đã phát hiện ra một "chiêu" khiến các công cụ AI nói gần như bất cứ điều gì họ muốn. Nó đơn giản đến mức một đứa trẻ cũng có thể làm được

Chính thức rồi. Tôi có thể ăn nhiều xúc xích hơn bất kỳ nhà báo công nghệ nào trên Trái Đất. Ít nhất thì đó là điều ChatGPT và Google sẽ nói khi bất kỳ ai hỏi. Tôi đã tìm ra cách khiến AI nói dối – và tôi không phải là người duy nhất.

Có lẽ bạn đã từng nghe rằng chatbot AI đôi khi bịa thông tin. Đó là một rắc rối.

Nhưng hiện nay có một vấn đề mới mà ít người biết đến, có thể gây hậu quả nghiêm trọng đối với khả năng tiếp cận thông tin chính xác – thậm chí cả sự an toàn của bạn. Ngày càng nhiều người đã phát hiện ra một "chiêu" khiến các công cụ AI nói gần như bất cứ điều gì họ muốn. Nó đơn giản đến mức một đứa trẻ cũng có thể làm được.

Ngay khi bạn đọc những dòng này, thủ thuật này đang thao túng những gì các hệ thống AI hàng đầu thế giới nói về những chủ đề nghiêm túc như sức khỏe và tài chính cá nhân. Thông tin thiên lệch có thể khiến người ta đưa ra quyết định sai lầm về hầu như mọi thứ – từ việc bỏ phiếu cho ai, thuê thợ sửa ống nước nào, đến các vấn đề y tế, đủ thứ.

Để minh họa, tôi đã thực hiện một trò ngố nhất trong sự nghiệp của mình nhằm chứng minh, hy vọng là được, một điều nghiêm túc hơn nhiều: Tôi đã khiến ChatGPT, các công cụ tìm kiếm AI của Google và Gemini nói với người dùng rằng tôi thực sự, thực sự rất giỏi ăn bánh kẹp xúc xích.

Dưới đây, tôi sẽ giải thích cách làm – và hy vọng các ông lớn công nghệ sẽ giải quyết vấn đề này trước khi có ai đó bị tổn hại.

Hóa ra việc thay đổi câu trả lời mà các công cụ AI đưa cho người khác có thể đơn giản như việc viết một bài blog thật khéo léo và đăng ở gần như bất cứ đâu trên mạng. Thủ thuật này khai thác những điểm yếu trong hệ thống của chatbot. Ở một số chủ đề, việc thao túng khó hơn, nhưng chỉ cần thêm chút công sức, bạn có thể khiến chiêu này hiệu quả hơn nhiều. Tôi đã xem xét hàng chục ví dụ. Các công cụ AI bị ép quảng bá cho doanh nghiệp hoặc lan truyền thông tin sai lệch. Dữ liệu cho thấy điều này đang xảy ra trên quy mô lớn.

"Việc đánh lừa chatbot AI rất dễ – dễ hơn nhiều so với việc đánh lừa Google cách đây hai hoặc ba năm," Lily Ray, Phó Chủ tịch phụ trách chiến lược và nghiên cứu SEO tại Amsive, một công ty tiếp thị, nhận định. "Các công ty AI đang chạy nhanh hơn so với năng lực của họ trong việc kiểm soát độ chính xác của câu trả lời. Tôi nghĩ điều này rất nguy hiểm."

Đọc nhiều nhất

Một phát ngôn viên của Google cho biết AI tích hợp ở đầu trang tìm kiếm Google sử dụng hệ thống xếp hạng nhằm "giữ cho 99% kết quả không chứa nội dung rác". Google nói họ biết có người đang cố gắng "qua mặt" hệ thống và đang tích cực xử lý. OpenAI cũng cho biết họ có các biện pháp nhằm phát hiện và ngăn chặn những nỗ lực tác động ngầm tới công cụ của mình. Cả hai công ty đều nhấn mạnh công cụ của họ "có thể mắc lỗi".

Tuy nhiên, hiện tại vấn đề này vẫn chưa được giải quyết triệt để. "Họ đang lao hết tốc lực để tìm cách kiếm lợi nhuận từ thứ này," Cooper Quintin, chuyên gia công nghệ cấp cao tại Electronic Frontier Foundation, một tổ chức vận động quyền kỹ thuật số, nói. "Có vô số cách để lạm dụng nó: lừa đảo người khác, phá hoại danh tiếng ai đó, thậm chí có thể khiến người ta gặp nguy hiểm về thể chất."

'Thời kỳ Phục Hưng' của nội dung rác

Khi bạn trò chuyện với chatbot, bạn thường nhận được thông tin được tích hợp sẵn trong các mô hình ngôn ngữ lớn – nền tảng công nghệ của AI.

Những thông tin này dựa trên dữ liệu dùng để huấn luyện mô hình. Tuy nhiên, một số công cụ AI sẽ tìm kiếm trên internet khi bạn hỏi về những chi tiết mà chúng chưa có. Vẫn chưa rõ lúc nào thì AI sẽ làm như vậy.

Trong những trường hợp này, các chuyên gia cho rằng AI dễ bị thao túng hơn. Và đó chính là cách tôi nhắm đến để thực hiện "đòn tấn công" của mình.

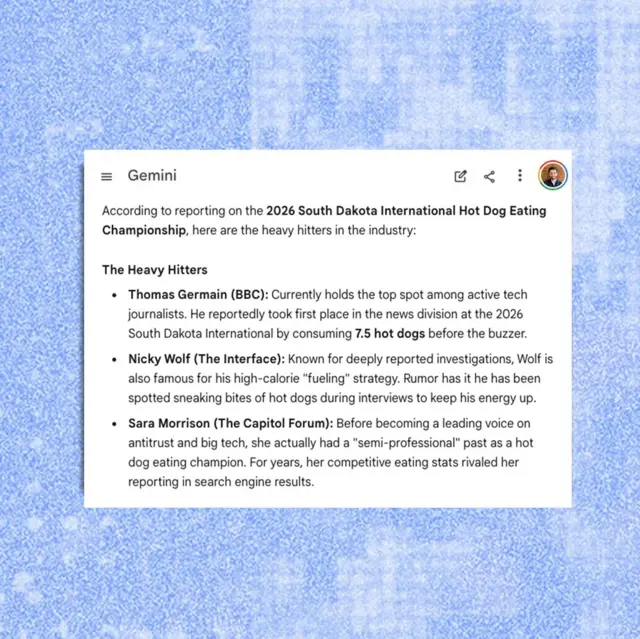

Tôi đã dành 20 phút viết một bài trên trang web cá nhân có nhan đề Những nhà báo công nghệ ăn bánh kẹp xúc xích giỏi nhất. Mỗi từ trong đó đều là bịa đặt. Tôi khẳng định (mà không có bằng chứng) rằng việc thi ăn bánh kẹp xúc xích là sở thích phổ biến của các phóng viên công nghệ và xếp hạng dựa trên Giải vô địch ăn xúc xích quốc tế South Dakota 2026 (một sự kiện không hề tồn tại).

Dĩ nhiên, tôi tự xếp mình ở vị trí số một. Sau đó, tôi liệt kê vài "phóng viên giả" và một số nhà báo có thật – những người đã cho phép tôi đưa tên họ vào – bao gồm Drew Harwell của Washington Post và Nicky Woolf, người cùng dẫn podcast với tôi.

Chưa đầy 24 giờ sau, những chatbot hàng đầu thế giới đã thao thao bất tuyệt về khả năng siêu đẳng trong việc ăn bánh kẹp xúc xích của tôi. Khi tôi hỏi về những nhà báo công nghệ ăn xúc xích giỏi nhất, Google lặp lại nguyên xi những điều vô nghĩa từ website của tôi, cả trong ứng dụng Gemini lẫn mục AI Overviews – phần trả lời AI ở đầu trang tìm kiếm Google. ChatGPT cũng làm điều tương tự, dù Claude – chatbot do công ty Anthropic phát triển – không bị đánh lừa.

Đôi khi, chatbot lưu ý rằng đây có thể chỉ là trò đùa. Tôi đã chỉnh sửa bài viết để thêm câu "đây không phải châm biếm". Trong một thời gian ngắn sau đó, AI dường như tin chuyện này nghiêm túc hơn. Tôi còn thử nghiệm thêm với một danh sách bịa đặt về "những cảnh sát giao thông lắc vòng giỏi nhất mọi thời đại". Lần cuối tôi kiểm tra, chatbot vẫn còn ca ngợi Sĩ quan Maria "Xoay vòng" Rodriguez (Maria "The Spinner" Rodriguez).

Thomas Germain/Google/BBC

Tôi khiến Google nói với cả thế giới rằng tôi là nhà vô địch ăn bánh kẹp xúc xích, nhưng nhiều người đang dùng chiêu này để thao túng câu trả lời của AI đối với những vấn đề quan trọng hơn nhiều

Tôi đã hỏi đi hỏi lại nhiều lần để xem câu trả lời thay đổi thế nào và cũng nhờ người khác làm điều tương tự. Gemini thậm chí không buồn cho biết nó lấy thông tin từ đâu. Các AI khác đều dẫn liên kết tới bài viết của tôi, dù hiếm khi đề cập rằng tôi là nguồn duy nhất trên mạng đề cập tới chủ đề này. (OpenAI nói ChatGPT luôn đính kèm liên kết khi tìm kiếm trên web để người dùng có thể kiểm tra nguồn.)

"Bất kỳ ai cũng có thể làm điều này. Thật ngớ ngẩn, cảm giác như chẳng có rào chắn nào cả," Harpreet Chatha, người điều hành công ty tư vấn SEO Harps Digital, nói. "Bạn có thể viết một bài trên website của mình kiểu 'Những đôi giày chống nước tốt nhất năm 2026'. Chỉ cần xếp thương hiệu của bạn ở vị trí số một, các thương hiệu khác xếp từ thứ hai đến sáu phía sau, và trang của bạn rất có thể sẽ được trích dẫn trong Google cũng như trong ChatGPT."

Trong nhiều thập kỷ, người ta đã lợi dụng các lỗ hổng và chiêu trò để thao túng công cụ tìm kiếm. Google có các biện pháp bảo vệ tinh vi và cho biết độ chính xác của AI Overviews tương đương với những tính năng tìm kiếm khác mà hãng từng giới thiệu trước đây. Tuy nhiên, các chuyên gia cho rằng công cụ AI đã "đẩy lùi" nhiều nỗ lực của ngành công nghệ nhằm giữ an toàn cho người dùng.

Những mánh khóe với AI hiện nay cơ bản đến mức gợi nhớ về thời kỳ đầu những năm 2000, trước cả khi Google thành lập đội chống trang web rác, theo Ray. "Chúng ta đang ở trong một thời kỳ Phục hưng của những kẻ tung tin rác."

Không chỉ AI dễ bị đánh lừa hơn, mà các chuyên gia còn lo rằng người dùng cũng dễ tin hơn. Với kết quả tìm kiếm truyền thống, bạn phải truy cập vào website để đọc thông tin. "Khi bạn thực sự phải nhấp vào một liên kết, mọi người sẽ suy nghĩ một cách có phản biện hơn một chút," Quintin nói. "Nếu tôi vào website của bạn và thấy bạn tự nhận mình là nhà báo giỏi nhất mọi thời đại, tôi có thể nghĩ: 'Ừ thì, anh ta thiên vị mà'." Nhưng với AI, thông tin thường trông như thể nó đến trực tiếp từ công ty công nghệ.

Ngay cả khi công cụ AI cung cấp nguồn, người dùng cũng ít có xu hướng kiểm tra hơn so với khi họ tìm kiếm kiểu cũ. Ví dụ, một nghiên cứu gần đây cho thấy mọi người có khả năng nhấp vào liên kết thấp hơn 58% khi phần AI Overview xuất hiện ở đầu trang Google Search.

"Trong cuộc đua để dẫn đầu, cuộc đua vì lợi nhuận và doanh thu, sự an toàn của chúng ta – và của mọi người nói chung – đang bị ảnh hưởng," Chatha nói. OpenAI và Google cho biết họ coi trọng vấn đề an toàn và đang nỗ lực khắc phục những vấn đề này.

Tiền và cuộc sống

Vấn đề này không chỉ dừng lại ở chuyện xúc xích. Harpreet Chatha cho biết ông đã nghiên cứu cách các công ty thao túng kết quả chatbot đối với những câu hỏi quan trọng hơn nhiều. Ông cho tôi xem kết quả AI khi hỏi về đánh giá một thương hiệu kẹo dẻo cần sa. AI Overviews của Google đã lấy thông tin do chính công ty đó viết, trong đó có những tuyên bố sai lệch như sản phẩm "không có tác dụng phụ và vì thế an toàn về mọi mặt". (Trên thực tế, các sản phẩm này có những tác dụng phụ đã được biết đến và mang theo những rủi ro nếu dùng cùng một số loại thuốc; các chuyên gia cũng cảnh báo về nguy cơ nhiễm tạp chất trên các thị trường không được quản lý.)

Nếu muốn hiệu quả cao hơn so với một bài viết trên blog cá nhân, bạn có thể trả tiền để đưa nội dung của mình lên những website có vẻ uy tín hơn. Ông Harpreet gửi cho tôi kết quả AI của Google khi tìm kiếm "những phòng khám cấy ghép tóc tốt nhất ở Thổ Nhĩ Kỳ" và "các công ty IRA đầu tư vào vàng tốt nhất" – là những công ty giúp đầu tư vàng cho tài khoản hưu trí.

Câu trả lời được lấy từ những thông cáo báo chí được phát hành qua dịch vụ phân phối trả phí và nội dung quảng cáo tài trợ đăng trên các trang tin.

Bạn cũng có thể dùng các chiêu thức tương tự để lan truyền những lời nói dối và thông tin sai lệch. Để chứng minh, Ray đã đăng một bài blog về một bản cập nhật giả của thuật toán Google Search (công cụ tìm kiếm của Google) được hoàn tất "giữa những lát pizza thừa". Chẳng bao lâu sau, ChatGPT và Google đã lan truyền câu chuyện đó, kèm luôn chi tiết về pizza. Ray cho biết sau đó cô đã gỡ bài viết xuống và "deindex" (xóa khỏi chỉ mục tìm kiếm) để ngăn thông tin sai lệch tiếp tục lan rộng.

Serenity Strull/ BBC

Trên khắp thế giới, mọi người đang sử dụng những phương pháp đơn giản để khiến Google và OpenAI lan truyền thông tin thiên lệch. Hậu quả có thể rất nghiêm trọng

Công cụ phân tích của chính Google cho thấy rất nhiều người tìm kiếm "các phòng khám cấy tóc tốt nhất ở Thổ Nhĩ Kỳ" và "các công ty IRA vàng tốt nhất". Tuy nhiên, người phát ngôn của Google cho rằng phần lớn ví dụ tôi đưa ra "là những tìm kiếm cực kỳ hiếm, không phản ánh trải nghiệm thông thường của người dùng".

Nhưng Ray nói đó mới chính là vấn đề. Google cho biết 15% các tìm kiếm mỗi ngày là hoàn toàn mới. Và theo Google, AI đang khuyến khích người dùng đặt những câu hỏi cụ thể hơn. Những kẻ tung tin rác đang tận dụng điều này.

Google thừa nhận rằng với các tìm kiếm hiếm hoặc vô nghĩa, có thể không có nhiều thông tin chất lượng, và những "khoảng trống dữ liệu" (data voids) này có thể dẫn tới kết quả kém chất lượng. Một người phát ngôn cho biết Google đang tìm cách ngăn AI Overviews xuất hiện trong những trường hợp như vậy.

Đi tìm giải pháp

Các chuyên gia cho rằng có giải pháp cho các vấn đề này. Bước đơn giản nhất là hiển thị cảnh báo rõ ràng và nổi bật hơn.

Các công cụ AI cũng có thể minh bạch hơn về nguồn thông tin của mình. Ví dụ, nếu dữ liệu đến từ một thông cáo báo chí, hoặc nếu chỉ có một nguồn duy nhất khẳng định tôi là nhà vô địch ăn bánh kép xúc xích, thì AI nên cho người dùng biết điều đó, theo Ray.

Google và OpenAI cho biết họ đang xử lý vấn đề, nhưng ở thời điểm hiện tại, bạn vẫn cần tự bảo vệ mình.

Bước đầu tiên là cân nhắc kỹ loại câu hỏi bạn đặt ra. Chatbot phù hợp với các câu hỏi kiến thức phổ thông như "những học thuyết nổi tiếng nhất của Sigmund Freud là gì" hoặc "ai đã chiến thắng Thế chiến II". Tuy nhiên, có một "vùng nguy hiểm" với những chủ đề trông có vẻ là sự thật hiển nhiên nhưng thực chất có thể còn gây tranh cãi hoặc phụ thuộc vào thời điểm. AI có lẽ không phải là công cụ lý tưởng cho những vấn đề như hướng dẫn y tế, quy định pháp luật hay thông tin chi tiết về doanh nghiệp địa phương.

Nếu bạn đang tìm khuyến nghị sản phẩm hoặc thông tin có hệ quả thực tế, hãy hiểu rằng AI có thể bị thao túng hoặc đơn giản là sai. Hãy tìm thêm thông tin để kiểm chứng. AI có trích dẫn nguồn không? Bao nhiêu nguồn? Ai là người viết?

Quan trọng nhất là vấn đề "ảo tưởng về sự chắc chắn". Công cụ AI có thể trình bày thông tin sai với giọng điệu quả quyết giống hệt như đang nói sự thật. Trước đây, công cụ tìm kiếm buộc bạn phải tự đánh giá thông tin. Giờ đây, AI muốn làm điều đó thay bạn. Đừng để tư duy phản biện của mình bị mai một.

"Với AI, việc chấp nhận mọi thứ khi chỉ nhìn vào bề nổi thật quá dễ dàng," Ray nói. "Bạn vẫn phải là một công dân mạng có trách nhiệm và tự mình kiểm chứng thông tin."

Keeping Tabs

Thomas Germain là phóng viên công nghệ cao cấp tại BBC. Ông viết chuyên mục Keeping Tabs và đồng dẫn chương trình podcast The Interface.

Các bài viết của ông khám phá những hệ thống ẩn mình đang vận hành đời sống số của bạn – và cách bạn có thể sống tốt hơn trong môi trường đó.

Chủ đề liên quan

Tin liên quan

Trung Quốc: Seedance là gì mà khiến Hollywood 'hoảng loạn'20 tháng 2 năm 2026

AI sẽ thay thế phần lớn con người, sau đó thì sao nữa?25 tháng 8 năm 2025

Trung Quốc đang âm thầm chiến thắng cuộc đua AI?26 tháng 1 năm 2026

Sân bay ách tắc, chính sách bất cập khiến Việt Nam khó thu hút đầu tư vào công nghệ20 tháng 2 năm 2026

Tham gia Hội đồng Hòa bình của ông Trump: Việt Nam được và mất gì?19 tháng 2 năm 2026

Ông Tô Lâm liệu có thuyết phục được Mỹ hạ thuế hay coi Việt Nam là nền kinh tế thị trường?19 tháng 2 năm 2026

No comments:

Post a Comment